In un recente esperimento eseguito dai ricercatori del Keen Security Lab del colosso cinese Tencent, alcuni ricercatori hanno escogitato un semplice sistema che potrebbe portare una Tesla a sterzare automaticamente in determinate condizioni.

Il tutto non avviene hackerando elettronicamente il sistema di guida autonoma AutoPilot. Al contrario, funziona usando piccoli e poco appariscenti adesivi sull’asfalto che ingannano la “guida assistita” della casa californiana.

Infatti sono stati posizionati sull’asfalto tre sticker praticamente invisibili a occhio nudo ma percepibili perfettamente dalla vettura.

I ricercatori hanno dunque incollato tre minuscoli adesivi in diagonale proprio per suggerire alla vettura una sorta di semicurva e portandola a deviare quando, al contrario, la corsia proseguiva dritto per dritto.

Il risultato è che la berlina elettrica di Elon Musk è stata condotta al di fuori della corsia con successo.

Il modello che è stato sottoposto all’esperimento era una Tesla Model S 75 dotata della versione potenziata dell’autopilot (Enhanced). Il tutto è stato operato in modo non tecnologico, a differenza di altre vulnerabilità.

Tergicristalli impazziti e guida da gamepad

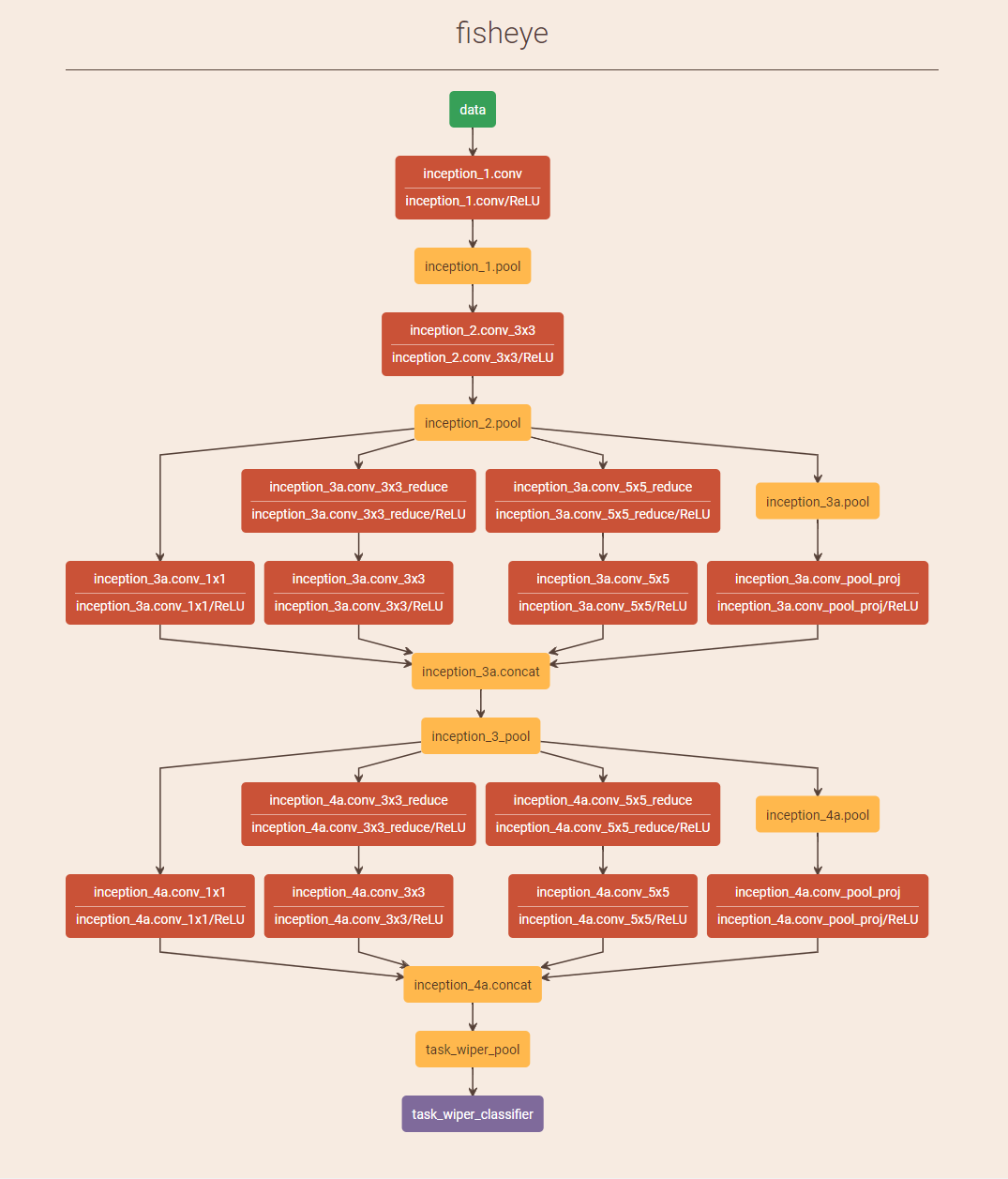

Altre piccole vulnerabilità analizzate riguardano funzioni forse meno importanti ma comunque significative nell’uso quotidiano come l’azionamento automatico dei tergicristalli. A differenza di altri sistemi che usano sensori ottici e a rilevamento di umidità, Tesla sfrutta l’azione combinata del riconoscimento delle immagini catturata da fotocamere attraverso l’intelligenza artificiale. Anche in questo caso si è riusciti ad ingannare il sistema azionando i tergicristalli senza pioggia.

Il clima umido è stato generato attraverso uno schermo posto frontalmente. Il sistema Tesla “interferito” ha restituito un risultato “improprio”, quindi ha acceso i tergicristalli, nonostante realmente non piovesse.

Dopo aver compromesso il sistema Autopilot su Tesla Model S (ver 2018.6.1), Keen Lab ha ulteriormente dimostrato che è in grado di controllare il sistema di guida Autopilot con un gamepad wireless, anche quando il sistema autopilota non è attivato dal conducente.

Feedback da parte di Tesla

Tesla si è espressa chiaramente su ognuno dei tentativi di “hackeraggio”. Vediamo il parere dei tecnici californiani punto per punto.

Il feedback di Tesla su Lane Recognition:

“In questa dimostrazione i ricercatori hanno adattato l’ambiente fisico (ad esempio mettendo degli adesivi sulla strada o modificando le linee della corsia) attorno al veicolo per fare in modo che l’auto si comporti diversamente quando è in uso il pilota automatico. Questo non è un problema del mondo reale dato che un pilota può facilmente scavalcare il pilota automatico in qualsiasi momento usando il volante o i freni e dovrebbe essere pronto a farlo”.

Verissimo, ma, secondo noi, la situazione diventa pericolosa se l’utente non si aspetta questo cambiamento improvviso in presenza di strada rettilinea, magari dopo ore di guida con l’autopilot inserito.

Il feedback di Tesla sull’hackeramento dei tergicristalli:

“Questa ricerca è stata effettuata visualizzando un’immagine su un televisore che è stato posizionato direttamente davanti al parabrezza di un’auto. Questa non è una situazione reale che i conducenti dovrebbero affrontare, né un problema di sicurezza. Inoltre, come affermiamo nel Manuale dell’utente, ‘L’impostazione automatica [per i nostri tergicristalli] è attualmente in BETA.’ Un cliente può anche scegliere di utilizzare l’impostazione manuale del tergicristallo in qualsiasi momento. “

il feedback di Tesla per la ricerca “Sistema di guida di controllo con gamepad”:

“La vulnerabilità primaria affrontata in questo rapporto è stata risolta da Tesla attraverso un robusto aggiornamento di sicurezza nel 2017, seguito da un altro aggiornamento completo sulla sicurezza nel 2018, entrambi rilasciati prima che questo gruppo ci riferisse questa ricerca. In tanti anni, non abbiamo mai visto un singolo lamentato per ogni singola ricerca effettuata da questo laboratorio. “

Informazioni su Tencent Keen Security Lab

Tencent Keen Security Lab (nell’abbreviazione “Keen Lab”) (nell’abbreviazione “Keen Lab”) è un gruppo di ricerca sulla sicurezza professionale, incentrato sulla ricerca sulla sicurezza delle informazioni, sulle tecniche di attacco e protezione, sotto il controllo della Tencent Company. Negli anni passati, Keen Lab ha sviluppato una partnership per la ricerca sulla sicurezza con produttori globali nei settori software, hardware e internet e ha ottenuto molti risultati a livello mondiale.

Durante l’anno 2016 e 2017, Keen Lab ha pubblicato la famosa ricerca a livello globale su “Tesla Model S e Model X Remote Hacking” sfruttando la pratica “Responsible Disclosure” per segnalare le vulnerabilità e le catene di attacco a Tesla.